Manuel Santillán Vásquez

Investigador del IDIC

Perfil en el CRIS Ulima

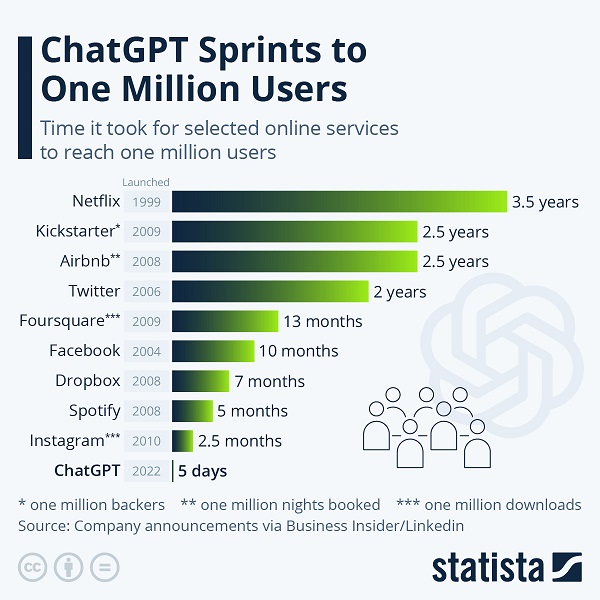

En las últimas semanas el posicionamiento de Open AI con su generador de textos ChatGPT se ha visto reflejado en el tráfico al dominio a niveles que ningún sitio web o red social jamás alcanzó a imaginar. ¿Pero qué implicancias trae esta tecnología además de su uso en distintos ámbitos laborales? En estas líneas me voy a permitir compartir algunas ideas sobre la inteligencia artificial (IA) y sumarme a la reflexión desde una perspectiva que he extrañado en lo que he venido leyendo. Me motiva, sobre todo, contrastar con la mirada principalmente economicista que se arroja sobre la IA y dimensionar el alcance de lo que esta tecnología podría significar para la vida de las personas y las sociedades en general.

Figura 1. Respuesta abrumadora del público. El ChatGPT llega al millón de usuarios en tan solo cinco días, mientras que a otras plataformas y aplicaciones les tomó meses o incluso años alcanzar esa misma cifra. (Buchholz, 2023)

La estructura: incluir o excluir

Me gustaría retroceder un paso y detenerme a sintetizar la estructura de esta tecnología, ya que así voy a permitirme desarrollar y contextualizar mejor algunas preguntas. Hay que recordar que el proyecto ChatGPT de Open AI nació como una utopía: la de crear un sistema de acceso abierto a la inteligencia artificial para beneficio de toda la humanidad (recordemos que así nació internet también) (Vincent, 2023). Para este fin se hizo necesario sustraer información de internet y ordenarla en parámetros, o conjuntos de datos, para luego “limpiarla” y terminar pasándola por un modelo de lenguaje generativo (aprendizaje profundo) que permita dar respuestas a las preguntas que se le hagan. Esto ha sido, a propósito, un proceso largo: ChatGPT no nació en el 2023, la inteligencia artificial data de mucho más atrás (Anyoha, 2017).

En el detalle, lo que hay detrás de esta tecnología son procesos matemáticos y algoritmos que responden a la lógica de predecir qué palabra podría seguir a otra y encontrar relaciones entre estas y así construir textos. De ahí el término, que según mi parecer le queda muy bien a ChatGPT, de “generador de textos”: generative pre-trained transformer. Sobre la estructura de esta tecnología, habría que imaginarnos que se ha logrado construir una especie de caja donde se encuentra un determinado volumen de datos, datos como los que conocemos que hay en internet, y que han sido escritos, producidos, generados por nosotros mismos, los humanos, en algún momento. Sin embargo, en esta caja solo se encuentra una pequeña parte de todo lo que hay en internet. Como podrán suponer, los datos de esa caja contienen datos erróneos y falsos también, a pesar de que sus desarrolladores han intentado verificarlos. Ahí es donde podríamos empezar a preguntarnos si es posible que la data de esa caja haya llegado a almacenar contenidos discriminatorios, racistas o sexistas. No sería la primera vez que el procedimiento de “purificar” la información pudiera haber tenido vacíos o fallas, al ser un proceso en el que intervienen computadoras y humanos por igual. Lo que está dentro de esa caja, además de no representar toda la información que existe en internet, tampoco es la más actualizada: según lo que se conoce, la información llega hasta el año 2021 (Grosdidier, 2023).

La pregunta que cae de madura es la siguiente: ¿cuáles podrían haber sido los criterios que se tomaron para incluir o excluir datos? Del mismo modo, podríamos preguntarnos también qué pasa con aquellos entornos que no han producido textos u otro tipo de información para internet o no la han producido en inglés. ¿No están incluidos en la caja? Recordemos que los principales núcleos generadores de conocimiento se encuentran en los centros de mayor desarrollo tecnológico y se hacen mayormente en inglés, y que un 40 % de la población mundial no tiene acceso a internet. Me niego a ideologizar esta discusión y usar el término poscolonialismo. A pesar de que ChatGPT puede escribir en quechua con rapidez (no me consta si lo hace correctamente), debo admitir que la data de la caja y el procedimiento detrás me dejan un amargo sabor.

Los procesos y el derecho a preguntar

No solo la estructura sino el procedimiento de esta inteligencia artificial dan lugar a cuestionamientos. Hay registros de investigadores en Alemania que indican que el generador de textos, al no tener datos para responder, se los inventa, arroja una especie de alucinación informática (ProLehre, 2023). Es más, la IA no logra distinguir entre ficción y realidad. A estas alturas, ya no se sabe realmente qué tan inteligente sea o si inteligencia, como término, requeriría redefinirse. Lo que está claro es que detrás de ChatGPT encontramos cálculos y aproximaciones matemáticas que forman parte del modelo de lenguaje generativo que usa. El generador de textos, en realidad, no llega a reflexionar y a razonar porque su principal función es calcular. El efecto de las palabras en un contexto dialógico desaparece completamente. La parte más problemática radica quizá en el hecho de que las redes neuronales como método de la IA buscan seguir un sistema e identificar un patrón lingüístico y arrojar un texto como resultado. Este procedimiento podría estar consolidando así determinadas ideas contenidas en los datos de la caja que siguen un patrón y que podrían replicar ideologías extremas, prejuicios y estereotipos nada buenos para la democracia y la humanidad en general.

La euforia que desata ChatGPT distrae y no nos deja cuestionarlo. Deberíamos permitirnos esto último y no dejar todo en las manos de las empresas desarrolladoras. Podríamos preguntarnos, por ejemplo, cuáles son los criterios definidos para entrenar al modelo de lenguaje generativo y si hay transparencia y mínimas consideraciones éticas al respecto. También creo que, si se trata de algo que va a impactar en nuestras vidas, deberíamos exigir claridad y evaluar críticamente las decisiones que se vayan a tomar. En esa línea, es interesante observar que hay una actividad creciente de las regulaciones europeas dentro del AI-ACT, en el que se está exigiendo a los desarrolladores de estas tecnologías que trabajen una mayor transparencia en sus procedimientos. Probablemente en las próximas versiones de estos generadores de texto se indique con mayor precisión las fuentes que usan y así el usuario podrá tomar una decisión respecto de la confiabilidad de las respuestas, asunto que de momento es una de las mayores debilidades de ChatGPT.

Nuevas exigencias, nuevas resignificaciones

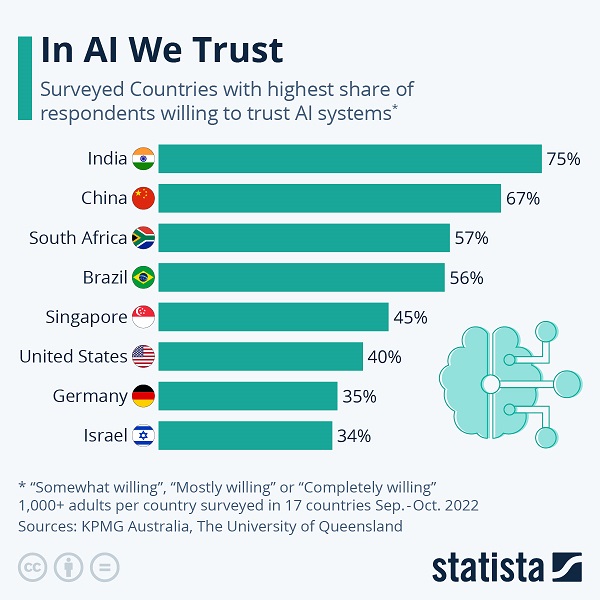

Mientras todo lo anterior viene ocurriendo, vemos dos campos en los que la discusión debería enfocarse un poco más: el práctico y el humanista. El primero tiene que ver con las exigencias que recaen sobre los usuarios y el segundo tiene que ver con el arte y la creatividad, que, así como ocurre con el término inteligencia, empiezan a exigir una redefinición. Sobre el campo práctico, se demanda al usuario conocer los límites de la inteligencia artificial, desarrollar un pensamiento que permita discernir de manera más precisa qué es lo que la inteligencia artificial puede hacer bien y qué no puede hacer tan bien. También se busca aclararle que la calidad de las respuestas que se obtienen de esta aplicación va a depender de la precisión de las preguntas que se le puedan hacer. Estamos pasando a una etapa que exige del usuario un pensamiento crítico, de evaluación y comprobación constante de los textos que recibe de la IA. Desde esa misma perspectiva, el usuario se va a encontrar con un número infinito de aplicaciones que trabajan sobre la base de ChatGPT y que serán útiles en distintos ámbitos profesionales como la arquitectura, el diseño, la programación, la educación y la investigación, entre otros. Con ello, las exigencias para admitir su uso se van a hacer mucho más necesarias. La ética y el uso responsable de la información pasan a una dimensión mayor.

Figura 2. Nivel de confianza en la IA según país. (Zandt, 2023)

El otro campo, el humanista, tiene que ver con el arte y la creatividad. Hoy sabemos que la inteligencia artificial es capaz de generar una pintura que se haya nutrido de cientos de imágenes hechas por un artista plástico con anterioridad. Sabemos que la inteligencia artificial ha sido capaz de terminar de componer la décima sinfonía de Beethoven (Telekom, 2021) y que es capaz de escribir sonetos o una canción de rap en el más fino estilo neoyorquino. Es ahí donde podríamos preguntarnos si esas “creaciones” no son meros ejercicios introspectivos [1] que replican aquello que se encuentra en la caja, como describíamos al principio. La cultura y la filosofía a lo largo de los siglos, además de traducir simbólicamente el quehacer, la realidad, los miedos y las ilusiones del ser humano, han procesado las distintas etapas por las que la humanidad ha pasado. Siempre la cultura ha significado un salto de un espacio a otro, la filosofía ha buscado constantemente entender, interpretar y buscar nuevos espacios de significación. Si queremos creer que la IA es la nueva herramienta que nos permite crear arte, solo nos basta mirar la estructura sobre la que opera. ¿No se trataría acaso de una actividad que únicamente replica aquello que se encuentra en la caja y que no da ese salto cualitativo a otros paradigmas culturales?

La IA y el futuro tecnológico

Nos encontramos, pues, frente al nacimiento de nuevas categorías legales, éticas, culturales y filosóficas, y estamos en un contexto acelerado que en los próximos meses probablemente vea surgir nuevos generadores de textos cada vez más especializados. Surgirán nuevas empresas y nuevos modelos de lenguajes generativos que van a ofrecer contenidos que no habrán sido procesados por Open AI. Van a coexistir varias cajas generadoras de textos y de otros formatos de contenidos cuya perdurabilidad dependerá del grado de fiabilidad que les otorguen a sus datos y, obviamente, empezarán a costar. De hecho, ChatGPT ya empezó a cobrar y es ahí donde podríamos plantearnos nuevas preguntas: ¿Renunció Open AI a la idea de crear un sistema de acceso abierto a la inteligencia artificial para beneficio de toda la humanidad? ¿La brecha de acceso al conocimiento no se estaría ampliando todavía más? ¿No va la información de la mano con la educación, ambas claves para la construcción de la paz, la confianza y el desarrollo? No, no se trata de estar contra la tecnología, sino con ella, y de permitirnos hacer preguntas sobre las que todavía hay muy pocas respuestas.

Nota

[1] Esto se refiere a que la IA mira dentro de lo que hay en la caja y de ahí saca la información.

| Citar esta entrada de blog (APA, 7.a edición): Santillán Vásquez, M. A. (2023, 3 de abril). ChatGPT de Open AI: muchas preguntas, pocas respuestas. Scientia et Praxis: Un blog sobre investigación científica y sus aplicaciones. https://www.ulima.edu.pe/instituto-de-investigacion-cientifica/blogs/chatgpt-de-open-ai-muchas-preguntas-pocas-respuestas |

Referencias

Anyoha, R. (2017, 28 de agosto). Can machines think? Science in The News [Special Edition on Artificial Intelligence]. https://sitn.hms.harvard.edu/flash/2017/history-artificial-intelligence/

Buchholz, K. (2023, 24 de enero). ChatGPT sprints to one million users. Statista. https://www.statista.com/chart/29174/time-to-one-million-users/

Grosdidier, S. (2023, 21 de marzo). ChatGPT: Das kann der Chatbot mit der künstlichen Intelligenz. Praxistipps. https://praxistipps.chip.de/chatgpt-das-kann-chatbot-mit-kuenstlicher-intelligenz_153781

ProLehre. (2023, 31 de enero). Einsatz von ChatGPT in der Lehre. https://www.prolehre.tum.de/fileadmin/w00btq/www/Angebote_Broschueren_Handreichungen/prolehre-handreichung-chatgpt-v2.2.pdf

Telekom. (2021). Special Beethovens Unvollendete. https://www.telekom.com/de/konzern/themenspecials/special-250-jahre-beethoven/beethovens-unvollendete

Vincent, J. (2023, 15 de marzo). OpenAI co-founder on company’s past approach to openly sharing research: ‘We were wrong’. The Verge. https://www.theverge.com/2023/3/15/23640180/openai-gpt-4-launch-closed-research-ilya-sutskever-interview

Zandt, F. (2023, 29 de marzo). In AI We Trust. Statista. https://www.statista.com/chart/29602/trust-in-ai-systems-around-the-world/

Add new comment